Система хранения данных RAIDIX с использованием кластерной файловой системы HyperFS позволяет легко расширять емкость архива и обеспечивать совместный доступ с множества рабочих станций.

«Ред Медиа» (входит в ГК ГПМ КИТ в составе «Газпром-медиа») — ведущая российская телевизионная компания по производству и дистрибуции тематических телеканалов для кабельного и спутникового вещания. Дистрибуционный пакет компании представлен 38 телеканалами во всех основных телевизионных жанрах. В области дистрибуции «Ред Медиа» сотрудничает с более 1900 операторами на территории России, стран СНГ и Балтии, а ее телеканалы доступны зрителям в 980 городах на территории 43 стран мира.

Одним из важнейших преимуществ телекомпании является собственная производственная база, позволяющая выполнять весь цикл работ, связанных с видеопроизводством — от подготовки и монтажа контента до полной автоматизации эфира.

В «Ред Медиа» функционирует собственный современный эфирный комплекс, который поддерживает до 64 каналов в HD-стандарте. В его основе лежит система автоматизированного управления процессами, безленточная технология обработки материалов и механизмы 100% резервирование ресурсов при вещании. Все это реализовано на базе современной ИТ-инфраструктуры, которая способная работать под интенсивными потоковыми нагрузками.

Задача

Для обеспечения эффективной работы видеопроизводства и процессов телевещания необходим общий архив материалов, с которым одновременно смогут работать специалисты различных направлений. Такой архив можно создать за счет единого файлового пространства, развернутого поверх масштабируемой системы хранения данных.

Отказоустойчивая СХД

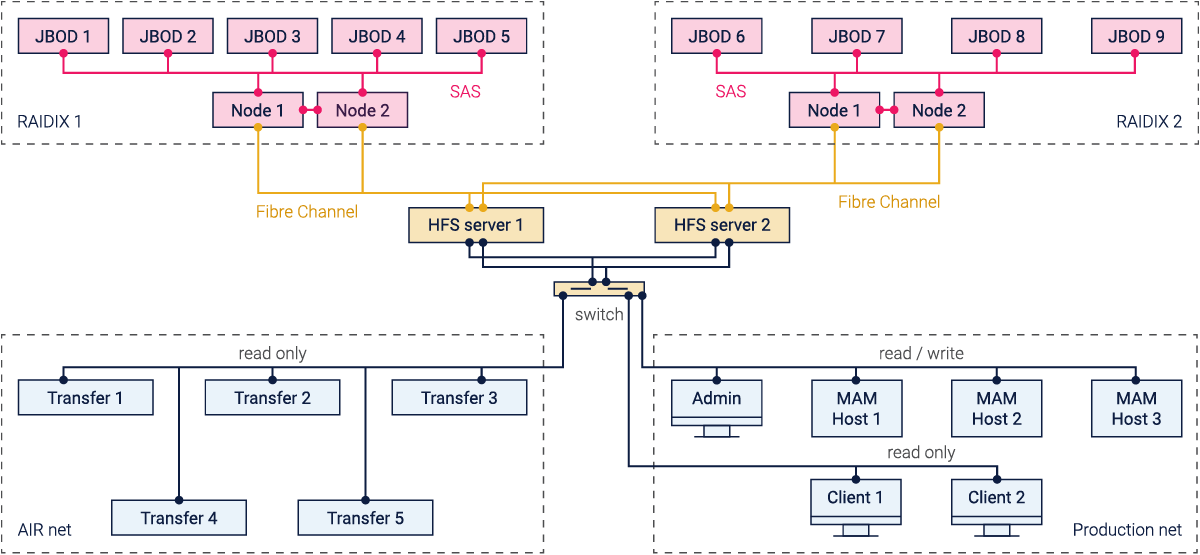

С 2016 года в компании используется двухконтроллерная СХД на базе ПО RAIDIX.

Для архива видеоматериалов был создан том данных, который расширялся по мере добавления нового оборудования. Благодаря неограниченному размеру тома и возможности легкого «растягивания» его на новые RAID-массивы, к системе подключили 5 дисковых полок, достигнув объема рабочего пространства в 2 ПБ.

Необходимость расширения

Дальнейшее масштабирование за счет подключение новых JBOD имело аппаратные ограничения, поэтому появилась потребность в организации единого горизонтально-масштабируемого хранилища, которое будет поддерживать дальнейшее увеличение объема без остановки системы.

Решение

Горизонтально-масштабируемая СХД

Для гибкого горизонтального масштабирования системы хранения данных была выбрана кластерная файловая система HyperFS. Она позволяет создать общее хранилище данных из нескольких СХД, объединяя их полезный объем и вычислительные ресурсы контроллеров.

Пределы масштабирования HyperFS

• До 4093 томов в одной файловой системе

• До 4 млрд. объектов в одной файловой системе

• До 64 ЗБ объема хранения (теоретический максимум)

Добавление второй двухконтроллерной системы и развертывание HyperFS позволило создать единую горизонтально-масштабируемую СХД емкостью 4 ПБ. Такое решение поддерживает одновременно до 64 подключений по блочным протоколам, среди которых могут быть как клиенты, так и файловые шлюзы SONG (Scale-Out NAS Gateway). Через SONG администратор может обеспечить файловый доступ уже более чем 1500 пользователям.

Scale-Out NAS Gateway

• SMB протокол: до 2048 клиентов

• FTP протокол: до 1600 клиентов

• NFS протокол: количество клиентов не ограничено

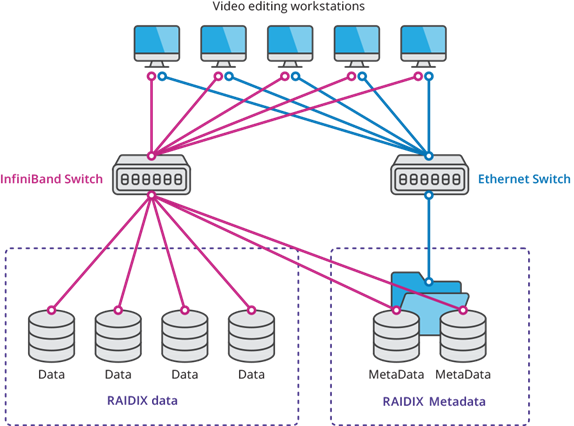

Архитектура хранилища

Итоговое решение состоит из двух отказоустойчивых СХД, которые объединены кластерной файловой системой HyperFS. Файловая система управляется выделенными серверами метаданных с функцией файловых шлюзов SONG (HFS server 1 и HFS server 2), а все метаданные размещаются на выделенном RAID10 в СХД RAIDIX.

От этих серверов клиентам предоставляется файловый доступ через Ethernet-коммутатор. Клиенты объединены в две сети: в AIR-net находятся сервера (Transfer 1-5) для телевещания, в Production-net находятся MAM-сервера (Media Assets Management) и рабочие станции.

Партнер-интегратор

Интеграцию решения и поставку программно-аппаратного комплекса провела компания SRV–TRADE (srv-trade.ru) — системный интегратор и поставщик оборудования для построения и управления IT-инфраструктурой предприятий. Компания SRV-TRADE является действующим партнером ведущих мировых производителей серверного и сетевого оборудования, программного обеспечения и комплексных решений, в том числе — в сфере хранения данных.

Результаты

Система хранения данных RAIDIX с кластерной файловой системой HyperFS создает в телекомпании «Ред Медиа» гибкое горизонтально-масштабируемое хранилище емкостью 4 ПБ. Увеличение объема архива теперь возможно «на горячую», без остановки системы и прерывания процессов вещания и видеопроизводства.

Помимо этого, такая система хранения может предоставлять одновременный файловый и блочный доступ с балансировкой нагрузки множеству клиентов. Вместе с механизмом горизонтального масштабирования это дает техническим службам компании широкие возможности для гибкого проектирования ИТ-инфраструктуры.

Задача по обработке видеоконтента

Colorkitchen (www.colorkitchen.ru) – профессиональная студия постродакшн, занимающаяся цветокоррекцией кино, рекламы и музыкального видео для клиентов по всему миру.

Для работы со многими параллельными проектами и эффективной обработки видеоконтента с нескольких рабочих машин студия цветокоррекции Colorkitchen нуждалась в высокопроизводительной и надежной системе хранения данных.

Среди требований студии были как функциональные, там и коммерческие составляющие. Выбранная СХД должна была обеспечивать оптимальное соотношение цены и производительности, совместимость со стандартным серверным оборудованием и эластичную масштабируемость с минимальными затратами на оборудование.

В части обработки больших объемов данных студия Colorkitchen сделала акцент на:

- высокой производительности системы при последовательных нагрузках;

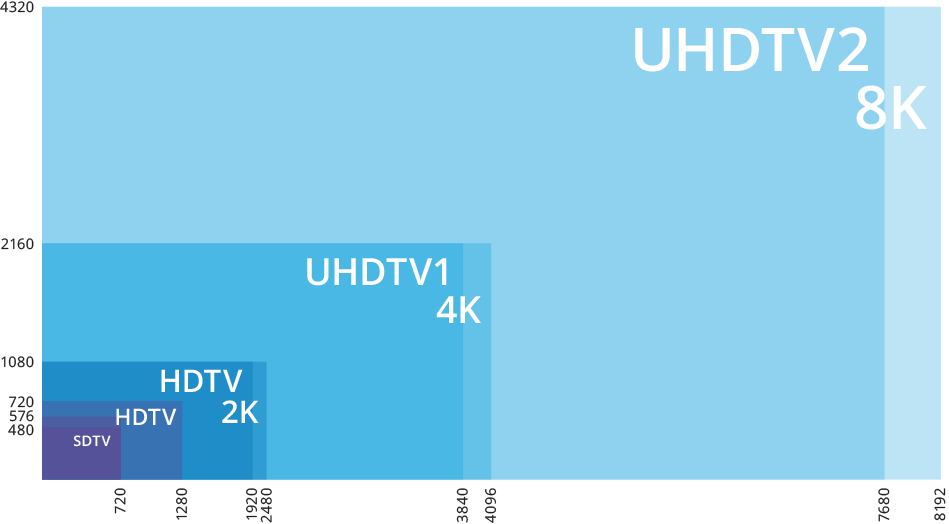

- поддержке видеоформатов высокого разрешения (HD/2K/4K);

- возможности настройки приоритетов по профессиональным приложениям;

- обеспечении высокого уровня QoS (качества обслуживания).

Ключевой задачей для студии цветокоррекции стала обработка видео в максимально сжатые сроки. В технической плоскости это требование подразумевает высокую пропускную способность и отказоустойчивость оборудования на всех стадиях работы с видеоматериалом.

СХД для студии цветокоррекции

Программно-аппаратный комплекс RAIDIX удовлетворил высочайшим требованиям по скорости и отказоустойчивости и обеспечил одновременную работу с видеоконтентом с нескольких рабочих станций без задержек и падения производительности.

В Colorkitchen была поставлена СХД на базе RAIDIX – SAN с большой емкостью хранения, возможностью расширения с помощью дисковых полок JBOD, соединением по Fibre Channel 16 Гб, высокой производительностью и поддержкой множества потоков 2К/4К видео.

Целостность данных без потери кадров обеспечивается уникальными алгоритмами компании «Рэйдикс», включая RAID 6 с двойной четностью и RAID 7.3 с тройной четностью. Так, RAID 7.3 гарантирует бесперебойную работу системы с неснижаемой производительностью даже при отказе до 3 дисков массива.

Совместимость ПО RAIDIX со стандартными серверными комплектующими х86-64 позволила оптимизировать RAID-массивы под конкретные задачи студии и снизить общую стоимость обслуживания системы. Кроме того, RAIDIX позволяет установить профессиональное ПО для цветокоррекции непосредственно на узел хранения.

Результаты

Студия Colorkitchen использовала СХД на базе ПО RAIDIX при работе нам десятками проектов, включая фильмы «Духless 2», «Ледокол», «Викинг», «Притяжение», многочисленные видеоклипы и рекламные ролики. Технология RAIDIX позволила сократить среднее время, затрачиваемое на профессиональный грейдинг, в два раза за счет распараллеливания процессов обработки данных. Внедрение программно-аппаратного комплекса также позволило достичь высокой доступности данных (на уровне «шесть девяток»), быстрого развертывания и гибкого масштабирования системы.

Компания «Рэйдикс» регулярно модернизируют СХД, используемые студией, как в аппаратной, так и в программной части, и осуществляют техническую поддержку систем заказчика с 2013 года.

Преимущества решения на платформе RAIDIX для медиа индустрии:

- Передача видеопотоков без потери кадров.

- Рекордная скорость обработки множества параллельных видеопотоков 2K/4K благодаря оптимальной параллелизации вычислений в RAID.

- Распознавание и приоритизация нагрузок в соответствии с актуальными задачами заказчика.

- Универсальная поддержка протоколов SAN (Fibre Channel, InfiniBand, iSCSI, 12Gb SAS) и NAS (NFS, SMB, AFP, FTP).

- Экономия на аппаратном обеспечении за счет совместимости со стандартными серверными комплектующими и высокая масштабируемость.

- Регулярная модернизация аппаратной и программной конфигурации СХД.

Эффективное хранение файлов большого размера (десятки гигабайт) в различных отраслях, например, в диагностической медицине или ресурсоемких научных исследованиях, становится непростой задачей. Что касается медиаиндустрии, то здесь используются колоссальные объемы контента. Учитывая, что цифровое видео формата 2K или 4K требует значительно больше свободной емкости, чем файлы стандартного высокого разрешения, художественный фильм средней продолжительности может занимать до 2 терабайт данных.

Хранение данных в студии постпродакшн

С проблемой хранения и высокопроизводительной обработки данных сталкиваются студии постпродакшн и творческие объединения по всему миру. Так, пакистанская компания Sharp Image, занимающаяся видеомонтажом, производством визуальных эффектов и анимации, активно использовала цифровые форматы 2K и 4K и нуждалась в системе хранения данных, которая обеспечивает высокую доступность данных, оптимальную пропускную способность и возможность одновременной работы над контентом.

С 1994 года Sharp Image работает над художественными фильмами, анимацией, рекламными роликами и другими типами видеопродукции для таких крупных клиентов, как Colgate Palmolive, Pepsi Cola и Unilever.

Специалисты студии оперируют файлами терабайтных размеров и осуществляют видеомонтаж, цветокоррекцию и окончательную обработку материала с помощью таких ресурсоемких приложений, как DaVinci Resolve 12 от Blackmagic Design. В процессе работы видеомонтажеры сталкивались с критическим снижением производительности и повреждением исходных данных при попытке одновременного доступа к одними и тем же файлам с двух и более рабочих станций. Таким образом, целостность данных и соблюдение графика работ оказывались под угрозой.

Наличие узких мест в используемой студией NAS-системе с подключением по Ethernet 10 Гб зачастую приводило к задержкам и замедлению рабочего процесса. Внедренное ранее решение не обеспечивало нужной скорости и не было настроено под нужды медиаиндустрии, в частности, под нагрузки 2K и 4K.

Чтобы сохранить свои конкурентные преимущества, Sharp Image требовалось принять меры для улучшения производительности и обеспечения гибкой масштабируемости архитектуры хранения. Ключевой задачей для компании стало поддержание высокой пропускной способности, достаточной для бесперебойной работы над видеоматериалом без потерь кадров и задержек – с нескольких рабочих станций. Инженеры Sharp Image стремились обеспечить безопасный высокоскоростной доступ к совместно используемым файлам без приобретения дорогостоящего аппаратного контроллера метаданных.

СХД для инфраструктуры кинопроизводства

Компания Sharp Image выбрала программно-определяемую СХД RAIDIX, которая берет на себя функции контроллера метаданных и обеспечивает эластичную масштабируемости существующей инфраструктуры. Для поддержания пропускной способности на уровне 16 Гб/с Sharp Image использовала адаптеры Celerity™ FC от ATTO Technology.

Решение RAIDIX предоставляет широкую функциональность для управления кластерами хранения, включая SAN и горизонтально-масштабируемый NAS, и поддерживает все основные протоколы подключения. RAIDIX оптимизирует производительность с помощью исключения самых медленных дисков в массиве и упреждающей реконструкции данных «на лету», без обращения к физическим носителям. Кроме того, патентованные алгоритмы компании «Рэйдикс» позволяют обнаруживать и устранять скрытые повреждения данных без снижения общей производительности системы.

В соответствии с требованиями заказчика RAIDIX управляет узлами хранения и выполняет функции сервера метаданных. В то время как стандартные RAID-контроллеры обслуживают не более 32 дисков в массиве, технология RAIDIX поддерживает до 64 дисков и обеспечивает высокую масштабируемость архитектуры хранения.

В рамках предпродажной подготовки специалисты RAIDIX протестировали ПО, используемое Sharp Image, на выбранном оборудовании и зафиксировали требуемую пропускную способность и неснижаемую производительность.

«Благодаря ПО RAIDIX наши специалисты получили производительность, достаточную для обработки самых больших файлов без задержек и потери кадров. Теперь наша среда хранения обеспечивает высокую скорость работы и доступность данных, а также целостность видеоконтента».

Arifeen Yousufi, Заместитель директора по IT, Sharp Image

Результаты

Sharp Image использовала конфигурацию на основе шасси высокой плотности от SuperMicro и 24 дисков SATA 4 ТБ с общей емкостью 96 терабайт – под управлением ПО RAIDIX. Технология RAIDIX позволила заказчику настроить приложения для обеспечения максимальных скоростей на чтение и запись, а также сэкономить на покупке дорогостоящих RAID-массивов. Кроме того, RAIDIX поддерживает горизонтальное масштабирование конфигурации по требованию – путем добавления новых узлов хранения без простоя системы.

Благодаря эргономичному веб-интерфейсу RAIDIX позволяет легко настраивать системы хранения, собирать статистику и создавать отчеты для эффективного мониторинга производительности и оперативного устранения неполадок. RAIDIX также помогает конфигурировать систему под конкретные задачи заказчика и варьировать параметры доступа на чтение и запись.

Помимо внедрения СХД на базе RAIDIX компания Sharp Image воспользовалась преимуществами приоритетной круглосуточной техподдержки для обеспечения оптимального функционирования системы и соблюдения плотного график постпроизводства.

В данном техническом сценарии рассматривается применение технологии RAIDIX в сфере цветокоррекции видео. Медиаиндустрия в целом предъявляет высокие требования к производительности систем хранения. Это связано с общими тенденциями в индустрии: увеличением размеров изображения и количества кадров и появлением новой техники. Помимо специфики грейдинга и постпроизводства видео следует принимать в расчет и общетехнологические требования: возможность встраивания в существующую инфраструктуру, возможность масштабирования по объему и производительности, удобство управления, универсальность, плотность хранения информации и т.д.

Учитывая нужды медиаиндустрии, инженеры «Рэйдикс» предлагают решение, которое обеспечивает одновременный доступ к данным с нескольких монтажных станций и поддерживает стабильно высокую скорость обработки множественных несжатых видеопотоков 4К.

В этом документе вы найдете описание типовых задач по цветокоррекции, метрики производительности и коммерческие результаты использования RAIDIX.

Работа с «тяжелым» контентом

Критичные факторы хранения данных в среде видео постпродакшн включают в себя объем хранения, производительность, доступность и стоимость. Очевидно, что при увеличении частоты кадров пропорционально увеличиваются и требования к пропускной способности. Так, видеофайл, содержащий 60 минут записи, может достигать размеров до ~15 ТБ:

- Full HD (1920×1080) ~ 200 МБ/с — 720 ГБ/час видео

- 4k (4096×3072) ~ 1,5 ГБ/с — 5,4 ТБ/час видео

- 8k (8192×4320) ~ 4 ГБ/с — 14,4 ТБ/час видео

Видеомонтаж и цветокоррекция данных подразумевают необходимость считывать и записывать данные в реальном времени и работать с потоками несжатого видео. Задержки СХД могут привести к потере кадров, и в этом случае процесс придется начинать заново.

Ключевой задачей для студии цветокоррекции является обработка видео в максимально сжатые сроки. В технической плоскости это требование подразумевает высокую пропускную способность и отказоустойчивость оборудования на всех стадиях работы с видеоматериалом.

Задачи и решение

Среди требований студий цветокоррекции можно выделить как функциональные, так и коммерческие составляющие. Выбранная СХД должна обеспечивать оптимальное соотношение цены и производительности, совместимость со стандартным серверным оборудованием и эластичную масштабируемость с минимальными затратами на оборудование.

В части обработки больших объемов данных студии делают акцент на:

- высокой производительности системы при последовательных нагрузках;

- поддержке видеоформатов высокого разрешения (HD/2K/4K);

- возможности настройки приоритетов по профессиональным приложениям;

- обеспечении высокого уровня QoS (качества обслуживания).

Одной из важнейших задач в этой сфере также является поддержка ресурсоемких приложений для цветокоррекции, таких как Digital Vision Nucoda, DaVinci Resolve и др.

Классическое решение на базе RAIDIX для данного сценария включает в себя систему NAS или SAN с большой емкостью хранения, возможностью расширения с помощью дисковых полок JBOD, соединением по Fibre Channel 16 Гб, высокой производительностью и поддержкой множества потоков 2К/4К видео.

СХД под управлением RAIDIX строится с использованием стандартных аппаратных компонентов (корпуса, диски, интерфейсные контроллеры, память, процессоры и т.д.) и обладает высокими показателями надежности и скорости при невысокой стоимости хранения.

Целостность данных без потери кадров обеспечивается собственными алгоритмами компании «Рэйдикс», массивами RAID 6 с двойной четностью и 7.3 с тройной четностью. Так, RAID 7.3 гарантирует бесперебойную работу системы с неснижаемой производительностью даже при отказе до 3 дисков в массиве.

Кроме того, RAIDIX позволяет установить профессиональное ПО для цветокоррекции непосредственно на узел хранения, тем самым экономя аппаратные ресурсы.

Компоненты решения

Пример ИТ-инфраструктуры студии цветокоррекции:

Профессиональное оборудование

- Digital Vision Nucoda.

- Панель управления Digital Vision.

- All DVO.

- RedRocket-X.

- Экран Harkness Matte Preview Screen шириной 5,5 метров.

- DCI проектор Barco DP2K-12C.

- Xpand 3D cinema.

- Аппаратный осциллограф.

Хранение и сетевое оборудование

- Хранилище RAID-6 или RAID-7 для обработки 4K в реальном времени.

- SAN-сеть 16 ГБ Fiber Channel.

- Средний объем до 1 ПБ данных и выше в зависимости от количества проектов.

- Подключаются от 6 до 10 клиентов.

- Кластерная файловая система Tiger MetaSAN.

Технические показатели

Система позволяет работать одновременно с 10 рабочих станций с 4K контентом. Суммарная максимальная производительность системы — 12ГБ/с.

Результаты для бизнеса

Программно-аппаратный комплекс RAIDIX удовлетворяет высочайшим требованиям по скорости и отказоустойчивости и обеспечивает одновременную работу с видеоконтентом с нескольких рабочих станций без задержек и падения производительности.

Совместимость ПО RAIDIX со стандартными серверными комплектующими х86–64 позволяет оптимизировать RAID-массивы под конкретные задачи студии и снизить общую стоимость обслуживания системы.

СХД на базе ПО RAIDIX предоставляет возможность сократить среднее время, затрачиваемое на профессиональный грейдинг, в два–четыре раза за счет распараллеливания процессов обработки данных. Внедрение программно-аппаратного комплекса также позволяет достичь высокой доступности данных (на уровне «шесть девяток»), быстрого развертывания и гибкого масштабирования системы.

Внедрение СХД на базе RAIDIX для медийного заказчика обеспечивает:

- в среднем более 300 суток непрерывной записи в режиме онлайн — до проведения профилактики;

- поддержку режимов мультикамерного видеомонтажа;

- прозрачный мониторинг.

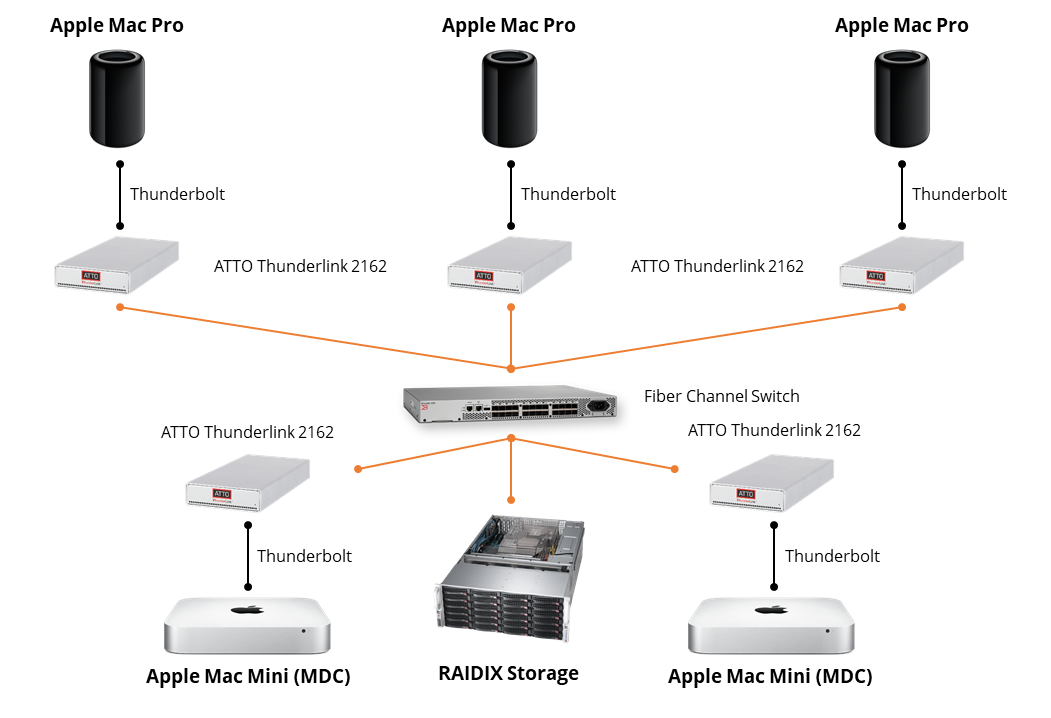

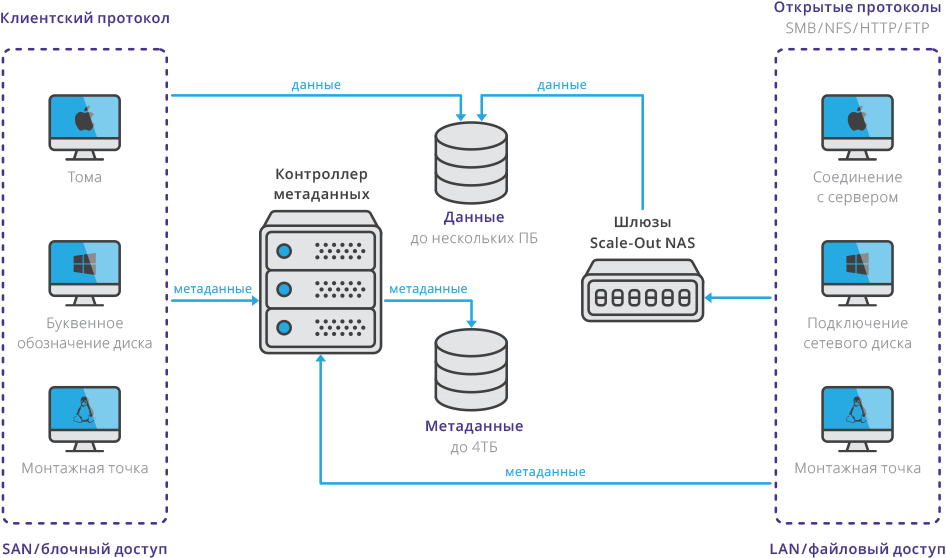

В данном техническом сценарии рассматривается применение технологии RAIDIX в сфере постпроизводства видео и медиаиндустрии. Одним из характерных примеров организации ИТ-инфраструктуры в рамках киностудии является использование рабочих машин Apple и файловой системы Apple Xsan. Инженеры «Рэйдикс» предлагают решение, которое обеспечивает одновременный доступ к данным с нескольких монтажных станций и поддерживает стабильно высокую скорость обработки множественных видеопотоков.

В связке с файловой системой Apple Xsan «Рэйдикс» предлагает комплексное решение для хранения данных в медиаиндустрии. В этом документе вы найдете описание типовых задач, рекомендации по оборудованию, метрики производительности и коммерческие результаты использования RAIDIX.

Введение

Среди критических факторов в среде видео постпродакшн следует назвать:

- Объем системы хранения данных

- Стоимость решения

- Производительность

- Доступность.

Кластерная файловая система должна обеспечить видеомонтажеру доступ к любому файлу с любой клиентской рабочей станции. Система Xsan предоставляет быстрый доступ к потоковым данным, который необходим для студий видео постпродакшн. В то же время файловая система Apple Xsan предназначена для обмена общими ресурсами между несколькими клиентами.

Сочетание системы хранения данных на базе программного обеспечения RAIDIX и кластерной файловой системы Xsan от компании Apple позволяет достичь требуемых для медиастудий высокой скорости и высокой доступности данных.

Ключ к построению медийных ИТ-систем — в правильном выборе компонентов, надлежащей конфигурации сети и системы хранения данных. В следующих разделах будут представлены рекомендации по оборудованию, архитектуре и настройке решения.

Задачи и решение

Студии постпродакшн в большинстве случаев используют оборудование компании Apple и профессиональный набор программного обеспечения, например, Apple Final Cut Pro, Adobe Premiere Pro, Autodesk Discreet Smoke, DaVinci Resolve и другие.

Постоянно растущий объем информации и использование ресурсоемкого ПО в постпродакшн предполагает растущий спрос на высокопроизводительные СХД с высокой доступностью данных. В то же время современные технологические процессы обработки видеоданных требуют, чтобы одни и те же файлы были доступны одновременно для нескольких монтажных станций, выполняющих различные задачи.

Другие ключевые требования медиастудий включают в себя:

- Высокую скорость доступа. Предполагает использование локального хранилища или высокоскоростной доступ к сетевой системе хранения данных.

- Распределенный доступ. Предполагает использование файловой системы с одновременным доступом к файлам со множества рабочих станций.

Одновременное решение этих полярных задач удачно реализовано в файловой системе Xsan. Apple Xsan — 64-битная кластерная файловая система Apple для Mac OS X или Mac OS X Server. Система предназначена для организации быстрого доступа к огромным массивам данных. Xsan позволяет совместно использовать файлы и тома размером до 16 ТБ каждый в высокоскоростной оптической сети.

Xsan характеризуется высоким уровнем доступности и почти полным отсутствием сбоев, предоставляя возможность использовать сеть SAN для консолидации данных и замены NAS-устройств.

RAIDIX — программное обеспечение для создания универсальных высокопроизводительных систем хранения данных с использованием стандартных аппаратных компонентов. ПО RAIDIX соответствует высоким требованиям производительности, отказоустойчивости и непрерывности работы за счет использования параллельных вычислений и уникальных математических алгоритмов собственной разработки.

RAIDIX поддерживает одноконтроллерный (задействован один узел) и двухконтроллерный (Active-Active) режимы работы системы. При двухконтроллерном режиме работы оба узла активны, работают одновременно и имеют доступ к единому набору дисков. Под узлами понимаются аппаратно-независимые компоненты системы хранения данных, которые имеют собственные процессоры, кэш-память, материнскую плату и могут быть объединены в кластер.

Далее в документе приведены необходимые элементы инфраструктуры для студий постпродакшн, использующих технологию Apple, и технические показатели. Также даны рекомендации по необходимому оборудованию, подключению и настройке высокоскоростной и высокодоступной системы хранения данных.

Компоненты решения RAIDIX&XSAN

Система хранения данных

В роли СХД выступает одноконтроллерный сервер SM 6048R-E1CR36N с установленным ПО RAIDIX и конфигурацией FC 16Gb + JBOD 847E1C-R1K28JBOD. Система поддерживает SATA, SAS, NL-SAS диски.

Контроллер метаданных

В роли контроллера метаданных (MDC) рекомендуется использовать Apple Mac Mini. Для обеспечения высокой доступности предпочтительнее использовать 2 контроллера метаданных.

Клиентская рабочая станция

В роли клиентских станций рекомендуется использовать Apple Mac Pro сервер.

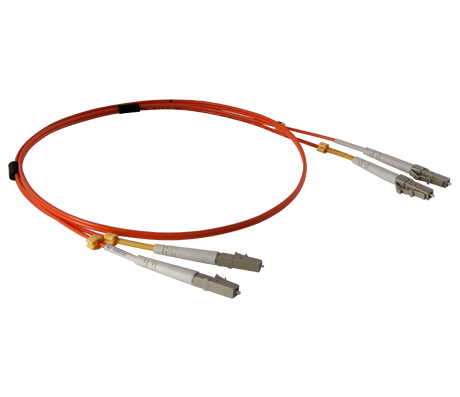

Fibre Channel/Thunderbolt

Mac mini и Mac Pro не поддерживают FC адаптеры, поэтому для подключения их в SAN-сеть рекомендуется использовать ATTO ThunderLink FC 2082 для Mac Mini и ATTO ThunderLink FC 2162 для Mac Pro.

Распределенная кластерная файловая система Xsan

Позволяет получить одновременный доступ к видеоматериалу с любой рабочей станции. Xsan должна быть предварительно установлена и лицензирована на Apple Mac Mini.

Fiber Channel (FC) коммутатор

При построении решения с небольшим количеством клиентов (до 20) подключение между FC адаптерами осуществляется напрямую от СХД к MDC и клиентам (без FC коммутатора).

Коммутация

Большинство всех компонентов соединены оптоволоконным кабелем с коннекторами LC-LC и подключаются непосредственно в адаптеры ATTO FC системы хранения данных и рабочих станций, FC Thunderbolt, FC коммутаторы (Рис. 1).

Кабель Thunderbolt

Оптические кабели подключаются к FC адаптерам через SFP трансиверы в каждый порт. Большинство FC адаптеров имеют в комплекте поставки SFP трансиверы, однако некоторые коммутаторы поставляются без трансиверов, что необходимо учитывать при закупке оборудования. Единственным исключением в схеме оптической коммутации является соединение между Apple Mac Mini и Fiber Channel Thunderbolt: оно осуществляется с помощью специального кабеля Thunderbolt.

Сервера MDC и все клиентские рабочие станции должны быть объединены ETH каналом (сетью) для метаданных.

Технические показатели

СХД имеет 4 порта Fibre Channel 16 Гбит, общая пропускная способность достигает 6 ГБ/с.

Кроме того, система на базе RAIDIX предоставляет возможность масштабирования как портов подключения, так и пропускной способности.

Архитектура решения

Ниже представлена подробная схема коммутации компонентов, необходимых для построения высокоскоростной и высокодоступной системы хранения данных для медиастудий.

Рисунок 1. Схема коммутации

Рекомендации по настройке СХД

Ниже приведены рекомендации по конфигурированию системы хранения данных для обеспечения высокой производительности и надежности.

Настройка ATTO FC Thunderbolt

На стороне клиентских рабочих станции рекомендуется использовать последние версии прошивки и драйвера. В большинстве случаев рекомендуется использовать настройки по умолчанию для FC Thunderbolt. Все настройки устанавливаются с помощью утилиты ATTO ConfigTool, которую можно загрузить с сайта производителя.

Диски

Рекомендуется использовать диски NL SAS 7K. Эти диски имеют лучшие показатели по стоимости 1 ГБ и обеспечивают высокую плотность и надежность хранения.

Выделенная подсеть Ethernet для MDC

Каждая рабочая станция Apple Mac Pro поставляется минимум с двумя портами Ethernet 1G, встроенными в материнскую плату. Один из этих портов должен быть подключен к изолированной, выделенной для каждого клиента Xsan подсети, и использоваться для первичного трафика метаданных Xsan. Apple Mac Mini, развернутый в качестве контроллера метаданных, имеет один порт Ethernet. Рекомендуемая конфигурация предполагает использовать этот порт в изолированной сети с другими клиентами. Такая конфигурация исключает доступ к Mac Mini за пределами изолированной подсети.

Один том (LUN) в одном RAID массиве

В конфигурации, где важна последовательная пропускная способность, желательно свести к минимуму количество операций поиска по дискам. В связи с этим рекомендуется создавать один том (LUN) на весь размер RAID массива. Кроме того, том Xsan следует создавать из блочных устройств одной системы хранения данных.

Конфигурация RAID-массива

Высокая скорость последовательного доступа и оптимальное использование дискового пространства достигается за счет параллельных вычислений и уникальных математических алгоритмов. Кроме того, в решении используется патентованный RAID-массив 7.3i с тройным распределением четности. Под контрольные суммы выделяется ёмкость трёх дисков, что обусловливает более высокую степень надёжности.

Для обеспечения высокой пропускной способности необходимо создать четыре инициализированных RAID 7.3i массива из 18 дисков каждый (2 массива — диски на узлах хранения; 2 другие массива — диски JBOD’а). Для каждого RAID-массива следует выделить кэш не менее 12 ГБ оперативной памяти. Остальные 8 дисков рекомендуется равномерно распределить в spare pool по 2 диска для каждого RAID массива.

Для тома под метаданные Xsan рекомендуется создать отдельный RAID 10 из двух 2,5” дисков, напрямую подключенных к материнской плате.

Результаты для бизнеса

Внедрение СХД на базе RAIDIX обеспечивает заказчику в медиаиндустрии:

- в среднем более 300 суток непрерывной записи в режиме онлайн — до проведения профилактики;

- поддержку режимов мультикамерного видеомонтажа;

- прозрачный мониторинг.

Использование RAIDIX позволяет одновременно работать с множественными 2К/4К потоками на высоких скоростях и, как следствие, сокращать время подготовки проектов к эфиру в 2–4 раза. Кроме того, ПО RAIDIX обеспечивает неснижаемую производительность СХД даже в случае выхода из строя до 3-х дисков одновременно и устраняет скрытые ошибки на носителях данных.

Система хранения данных для медиаиндустрии

Эффективное хранение больших файлов в различных отраслях, например, в диагностической медицине или ресурсоемких научных исследованиях, становится непростой задачей. Что касается медиаиндустрии, то здесь используются колоссальные объемы контента. Поскольку цифровое видео формата 2K или 4K требует в несколько раз больше свободной емкости, чем файлы стандартного разрешения, художественный фильм средней продолжительности может занимать до 2 ТБ данных в формате Full HD и до 15 ТБ в формате 8К.

Специалисты студий постпродакшн оперируют файлами терабайтных размеров и осуществляют видеомонтаж, цветокоррекцию и окончательную обработку материала с помощью ресурсоемких профессиональных приложений. Ключевой задачей для студий является поддержание высокой пропускной способности, достаточной для бесперебойной работы над видеоматериалом без потерь кадров и задержек, как правило, с нескольких рабочих станций.

При этом, учитывая растущие объемы видеоданных и ограниченную емкость хранения, студии постпродакшн и телеканалы нуждаются в высокомасштабируемых решениях. Зачастую, когда речь идет о петабайтах информации и кластерной организации хранения, возникает необходимость горизонтального масштабирования СХД.

При создании кластера хранения из нескольких узлов администратор системы сталкивается с несколькими ограничениями традиционных файловых систем: расположением метаданных и данных в одних и тех же разделах; недостаточной масштабируемостью по размеру, производительности, количеству файлов, вложенности папок и т.д.; проблемами с кроссплатформенностью и др. Логичным решением в таком случае становится распределенная кластерная файловая система.

В данном документе мы расскажем о типовых задачах медиакомпаний, метриках производительности и Scale-Out решениях на базе RAIDIX и высокомасштабируемой файловой системы HyperFS для крупных ИТ-инфраструктур.

Требования видеопроизводства и телевещания к СХД

Среди ключевых требований видеопроизводства и телевещания к СХД следует выделить:

- высокую пропускную способность и неснижаемую производительность даже в случае отказа дисков;

- возможность «горячей» замены аппаратных элементов без простоя;

- возможность настройки приоритетов по приложениям, используемым в технологическом процессе

- гибкую поддержку интерфейсов доступа к данным Fibre Channel, iSCSI, NFS, SMB, FTP, AFP

- высокую вертикальную и горизонтальную масштабируемость системы.

При работе с высокими нагрузками необходимо соблюдать соотношение производительности, плотности хранения и стоимости. Производительность системы зависит от количества дисков и от производительности каждого отдельного диска. Как правило, высокопроизводительная программно-определяемая технология с использованием вращающихся дисков вполне удовлетворяет потоковым задачам. В сочетании с полками высокой плотности создаются эффективные конфигурации для работы с большим количеством потоков или с потоками высокого разрешения. При необходимости дальнейшего масштабирования можно использовать кластерные решения, такие как системы на базе ПО RAIDIX и кластерной системы HyperFS.

Ключевыми критериями для горизонтально-масштабируемого решения, помимо высокой производительности и низких задержек, являются:

- единое адресное пространство для нескольких кластеров хранения;

- одновременный доступ по различным протоколам;

- файловый и блочный доступ к одним и тем же данным.

Задачи и решение

Видеомонтаж данных подразумевает необходимость считывать и записывать данные в реальном времени и работать с потоками несжатого видео. Задержки СХД могут привести к потере кадров, и в этом случае процесс придется начинать заново. Ключевой задачей для киностудий является обработка видео в максимально сжатые сроки. В технической плоскости это требование подразумевает высокую пропускную способность и отказоустойчивость оборудования на всех стадиях работы с видеоматериалом.

Медиахолдинги, работающие с десятками параллельных проектов, нуждаются в новых системах хранения данных или модернизации существующих конфигураций в виду увеличения объемов видеоконтента. Такая СХД должна была обеспечивать высокопроизводительное и надежное хранение петабайтных объемов данных с минимальными инвестициями.

Для примера возьмем систему с большой емкостью хранения (от 2U/48 ТБ до 4U/108 ТБ) на базе RAIDIX с возможностью подсоединения дополнительных дисковых полок, высокой производительностью и поддержкой множественных видеопотоков 2К/4К. Целостность данных без потери кадров обеспечивается патентованными алгоритмами компании «Рэйдикс», включая RAID 6 с двойной четностью и 7.3 с тройной четностью. Так, RAID 7.3 гарантирует бесперебойную работу системы с неснижаемой производительностью даже при отказе до 3 дисков массива.

RAIDIX в качестве управляющего ПО работает со стандартными комплектующими х86-64 (корпуса, диски, интерфейсные контроллеры, память, процессоры и т.д.), позволяет оптимизировать RAID-массивы под конкретные задачи холдинга и снизить общую стоимость обслуживания системы.

Решение RAIDIX поддерживает оборудование Аррlе, AJA, Blackmagic Design, успешно взаимодействует с управляющими средами Хsan, metaSAN, StorNext, FalconStor и профессиональными приложениями для монтажа (Adobe Premiere, Final Cut Pro, Avid, Smoke, DaVinci Resolve, SGO Mistika и др.). Кроме того, RAIDIX позволяет установить профессиональное ПО для цветокоррекции непосредственно на узел хранения, тем самым экономя аппаратные ресурсы.

Каковы сценарии применения RAIDIX для создания кластера хранения из нескольких узлов? Как уже упоминалось выше, для выполнения этой задачи недостаточно функционала традиционных файловых систем (ФС).

Ограничения классических файловых систем

- метаданные и данные хранятся на одних и тех же разделах;

- файлы «размазываются» по разделу, и возникают задержки доступа;

- отсутствует механизм, предотвращающий дефрагментацию;

- недостаточная масштабируемость по размеру, производительности, количеству файлов, вложенности папок и т.д.;

- «неродная» кроссплатформенность.

Названные проблемы решаются с помощью кластерных файловых систем. Так, система HyperFS от Scale Logic обеспечивает высокую масштабируемость прозрачно для клиента и одновременный доступ к данным с различных ОС (в частности, через файловые шлюзы). ПО RAIDIX в связке с HyperFS позволяет организовать единое адресное пространство для блочного и файлового доступа.

Технические преимущества совместного решения

- до 4 млрд. файлов в одном каталоге;

- до 4096 разделов, которые возможно объединить в одну ФС;

- отсутствие единой точки отказа;

- динамическое расширение ФС по емкости и производительности без простоев;

- поддержка последних версий популярных ОС — Mac/Windows/Linux.

Файловая система HyperFS SAN (рис. 1) обеспечивает необходимую избыточность, высокую доступность данных, зеркалирование путей и данных. HyperFS для SAN позволяет трансформировать несколько ФС или дисковых массивов iSCSI в кластер хранения, который поддерживает одновременное редактирование и воспроизведение данных с нескольких клиентских машин, обеспечивает высокую производительность и совместный доступ в рамках единого пространства имен. Система располагает опциональным контроллером метаданных (MDC) со структурой избыточности, SAN-структурой полной избыточности с зеркалированием метаданных и поддерживает конфигурацию с множеством путей в среде Fibre Channel и iSCSI. Система не имеет единой точки отказа и обеспечивает высокую стабильность хранения.

Возможности систем Scale-Out NAS, применяемых в крупных инфраструктурах в сфере медиа и развлечений, включают в себя консолидацию до 64 узлов в кластере, одновременный доступ по разным протоколам (SMB v2/v3, NFS v3/v4, FTP/FTPS, HTTP/HTTPS/WebDAV), балансировку нагрузки между узлами (Round-Robin, Connection Count, Load node), поддержку Active Directory.

Расширенные функции RAIDIX и HyperFS:

- оптимизация системы под большие и маленькие файлы;

- поддержка квот пользователей и папок;

- SNMP-мониторинг по SNMP для SONG и MDC;

- LDAP/Active Directory — возможность использовать локальную базу пользователей или интегрироваться с Active Directory;

- поддержку ACL — возможность использовать ACL на всех поддерживаемых ОС.

Таким образом, система на базе RAIDIX и HyperFS предоставляет киностудиям, студиям постпродакшн и телеканалам решение с высокой производительностью, единым адресным пространством, одновременным доступом по различным протоколам, низкими задержками, высокой расширяемостью, файловым и блочным доступом к одним и тем же данным.

Архитектура решения

Архитектура СХД (см. рис. 2) на базе ПО RAIDIX и кластерной файловой системы HyperFS состоит из трех основных компонентов:

- Узлы хранения (SharedDisk/СХД). Дисковые СХД, предназначенные для отказоустойчивого хранения информации

- Службы каталога (MDS). Предназначены для хранения ссылок на данные, арбитража и контроля доступа. Сами данные и метаданные службы каталога не хранят.

- Клиенты. В качестве клиентов RAIDIX могут выступать сервера или ПК с установленным специализированным клиентским программным обеспечением для доступа к общим данным.

При необходимости подключения большого количества клиентов — без установки на них клиентского программного обеспечения — в архитектуре решения предусмотрена возможность организации шлюзов файлового доступа (NAS Gateway), через которые осуществляется работа с данными.

Технические показатели решения

|

Емкость системы |

64 ЗБ (теоретическое ограничение) |

|

Максимальное количество файлов/объектов/папок |

До 4 000 000 000 при использовании тома метаданных размером 4 ТБ |

|

Размер файла |

64 ЗБ (теоретическое ограничение) |

|

Длина имени файла |

Windows: 255 символов ASCII; Linux/Mac: 255 символов ASCII |

|

Глубина каталога |

Windows: 244 символа; Linux: 4096 байт |

|

Максимальное количество LUN |

4093 |

|

Экспортируемые пути |

512 |

|

Количество контроллеров метаданных (MDC) |

До 2, могут быть настроены в режиме высокой доступности |

|

Количество конкурентных файловых систем |

16 |

|

Полная избыточность |

Поддерживается: нет единой точки отказа |

|

Динамическое расширение файловой системы |

Да, LUN могут добавляться без простоев |

|

Поддерживаемые клиентские ОС SAN |

Windows 7 32/x86_64/Win 8, Win 10 |

|

Поддержка SSD |

Да |

Результаты для бизнеса

Решение RAIDIX позволяет использовать множество узлов хранения (СХД), динамически распределяя информацию между ними и балансируя нагрузку. Архитектура решения позволяет добавлять к системе новые узлы хранения по требованию — без необходимости переносить данные и менять конфигурацию системы.

Основным преимуществом RAIDIX является возможность осуществлять на блочном уровне с высокой производительностью одновременную работу с данными, хранящимися на одной или нескольких СХД, с большого количества рабочих мест, что невозможно в классической SAN-архитектуре.

Технология RAIDIX в сочетании с файловой системой HyperFS удовлетворяет высочайшим требованиям по скорости и отказоустойчивости, обеспечивает одновременную работу с видеоконтентом с нескольких рабочих станций. Использование RAIDIX позволяет минимизировать расходы на апгрейд оборудования при создании кластеров хранения, горизонтально расширяя действующую инфраструктуру без простоев и снижения производительности.